Former les enseignants à l’IA : une approche par le modèle des 4A

Préambule

Un enseignant ou une enseignante a de bonnes raisons qui le ou la pousse à ne pas utiliser l’intelligence augmentée. Cela étant dit, en tant que collègue enseignant, formateur et en tant que citoyen, il me semble nécessaire que des temps soient alloués pour accueillir ces questionnements, pour les diriger et pour trouver des pistes ensemble. Tout cela pour mener, ou non, vers le changement de posture face à cet outil et que nous puissions créer, in fine, une culture commune avec un objectif simple en tête : l’acculturation et la sensibilisation à l’IA pour les élèves. Je rejoins donc ces propos : « Mais pour intégrer l’IA à l’école il faut une éducation numérique sérieuse et partagée. Pour que chaque élève puisse apprendre à utiliser ces outils avec discernement, à comprendre leurs biais et leurs limites, à développer un esprit critique face aux algorithmes, il faut aussi former leurs enseignants. » [1] .

Table Of Content

La résistance face à un outil numérique est toujours une bonne chose. Une résistance n’est jamais que ça, elle n’est que le témoin de questionnements internes en lien avec l’usage d’un outil, dans notre cas l’IA, son utilité et son utilisabilité dans un cadre scolaire, la pluralité des fonctionnalités qu’il propose par rapport à d’autres ou encore la réflexion autour de limites que l’on pourra rencontrer sur le terrain. Enfin, il convient de mentionner l’acceptabilité de l’outil. En effet, l’intelligence augmentée questionne à de nombreuses échelles parce qu’elle vient à la rencontre de nos valeurs, de notre éthique personnelle et professionnelle.

J’ai découvert l’an passé un triptyque intéressant que j’ai légèrement abordé plus haut : utilité, utilisabilité et acceptabilité. Trois piliers qui nous invitent à interroger la nécessité d’un outil et son intégration dans un contexte donné. Suite à cela, on m’a parlé d’un autre modèle tout aussi intéressant : le modèle des 4A. Je vous propose donc d’explorer l’utilisation de l’IA dans un contexte pédagogique au travers de ce modèle pour mieux comprendre les résistances des enseignants. Pourquoi ? Selon une enquête de Heaven[2], 90% des élèves de seconde utilisent l’IA pour s’aider à faire leur devoir. Les élèves s’approprient davantage l’outil que les enseignants : « l’acculturation se fait en ordre dispersé ». Aussi, selon l’enquête BORN AI 25[3], près d’un jeune sur deux parle à l’IA comme à un ami. Il semble important ici de prendre en compte les limites et les risques liés à l’utilisation de tels outils.

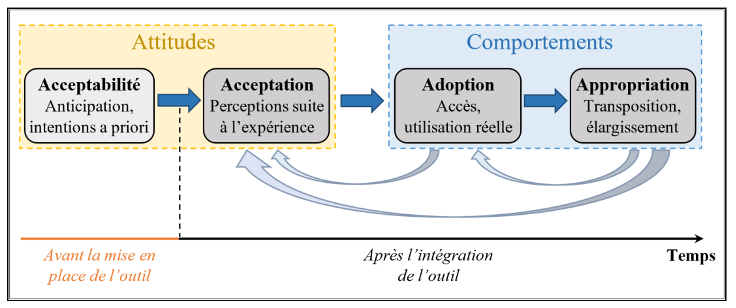

Le modèle des 4A[4] expliqué brièvement

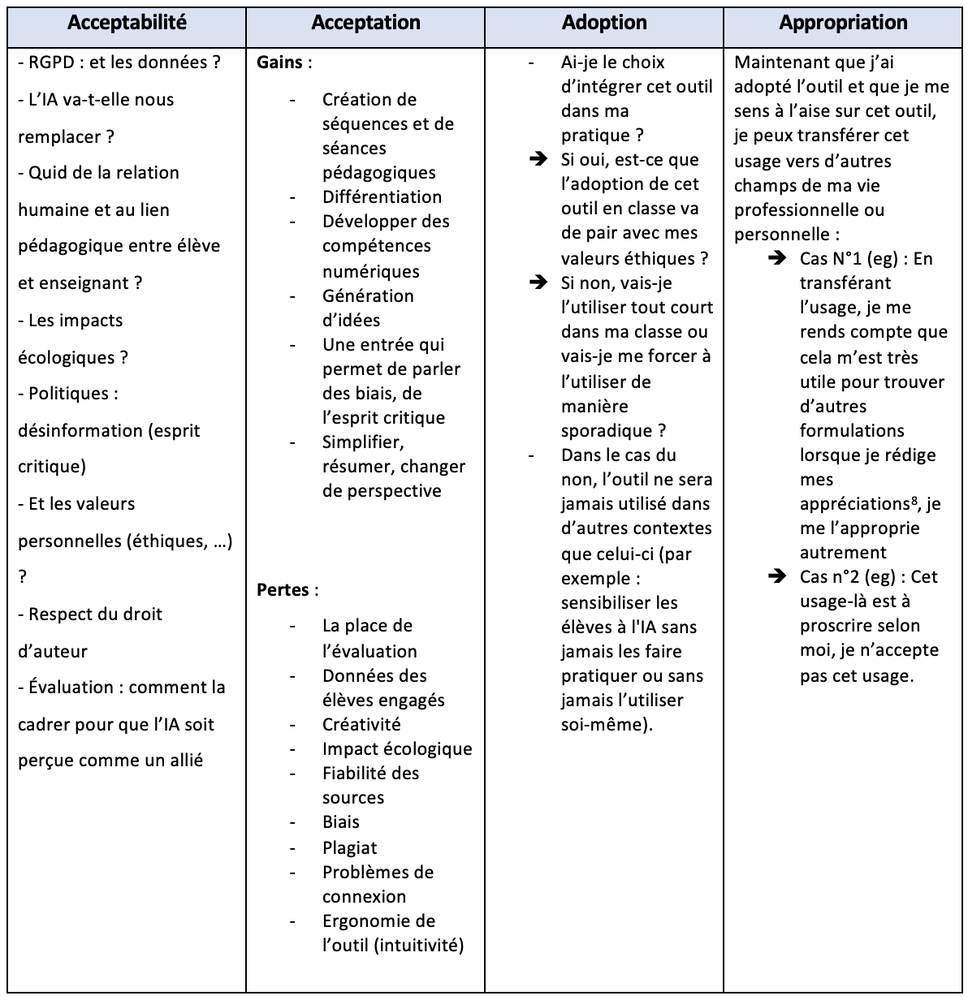

Le A au cœur de ce modèle est l’acceptation, les trois autres termes orbitent autour de cette notion qui est capitale. L’acceptabilité d’un outil peut découler dans un premier temps des représentations que l’on se crée autour de celui-ci. Il s’agit somme toute d’un mélange entre nos valeurs et nos a priori, c’est-à-dire l’image que l’on se fait de cet outil. L’idée d’acceptation ensuite est liée à l’expérience d’utilisation, pour arriver à cette étape, il est nécessaire qu’une interaction ait eu lieu entre l’usager et l’outil. Ensuite, se pose la question de l’adoption de ce dernier dans son quotidien et peut mener, ou non, à une forme d’appropriation. L’appropriation c’est le transfert d’usage d’une sphère à une autre, nous concernant, d’une utilisation personnelle à une utilisation à des fins professionnelles pour soi ou pour la classe par exemple. Il ne faut pas voir ce modèle comme un schéma figé mais bien comme un continuum. En fonction de l’utilisation réelle de l’outil, je peux très bien remettre en question son acceptation ou bien même questionner son adoption quand que je transfère l’usage vers une pratique de classe.

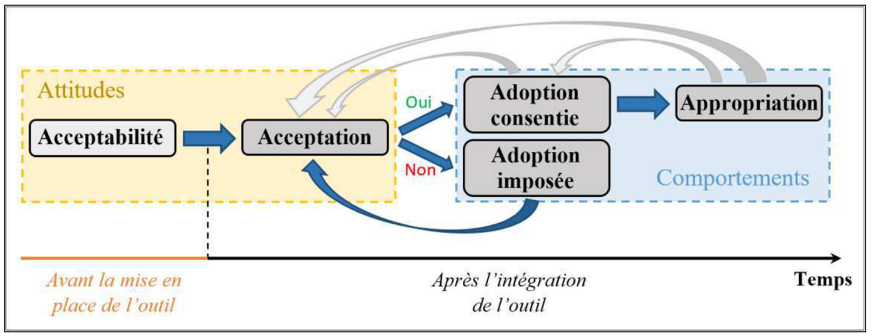

Le modèle des 4A dans un contexte institutionnel tel que l’école

Dans le contexte scolaire, le modèle a été légèrement modifié afin de rajouter un item qui est essentiel : le consentement. Il existe en effet des cas dans lesquels un outil s’impose aux professionnels de l’éducation. Pour qu’un outil soit utilisé en classe, il faut que son adoption soit consentie et n’émane pas d’une décision politique par exemple. Ce n’est pas réellement notre cas avec l’intelligence augmentée puisque ce sont davantage les usages élèves et l’intégration de cet outil dans de nombreux domaines de la société qui nous incitent à questionner son usage.

L’acceptabilité

Depuis que l’intelligence artificielle s’est répandue dans les maisons et dans le monde du travail, différentes attitudes ont été adoptées. Avant même de tester cet outil, des représentations se sont imposées à nous, créées par des imaginaires que nous avons inventés par la fiction littéraire ou bien par les films. Des représentations sont déjà présentes dans nos esprits et se forment au gré des discours médiatiques, de nos croyances, de nos valeurs et de notre expérience. Il peut aussi s’agir d’expériences passées avec les outils numériques de manière générale. La représentation que l’on se fait du numérique et de son utilité dans un contexte scolaire est un facteur qui joue sur la notion d’acceptabilité. En termes de valeur et d’éthique personnelle, on peut également se poser des questions sur les données engagées par l’intelligence artificielle, par son coût énergétique, par ce que cela vient interroger notamment sur les biais et sur l’esprit critique ou bien sur le possible remplacement d’une profession par un tel outil. Tout cela est en nous avant même d’avoir testé l’outil. Ces représentations suffisent déjà pour alimenter nos craintes ou bien notre envie de tester l’intelligence augmentée. Des collègues en formation nous font part parfois de leurs craintes de voir des professions être remplacées par l’IA ou bien que la relation pédagogique se déshumanise par cette arrivée. Une formation peut par exemple aider à mieux comprendre comment l’IA peut être un réel levier aux apprentissages et qu’elle va nous permettre d’accompagner les étudiants différemment en allant chercher des compétences plus complexes. Il faut être prêt à entendre que le rôle du savoir, de l’enseignant et de l’élève[5] peuvent grandement évoluer avec cet outil. Comme le résume très bien Anne-Lise Bouchut[6] : « l’enseignant ne tire pas son autorité uniquement du savoir. Il la fonde aussi sur sa compétence (sa capacité à créer des situations d’apprentissage) et sur sa responsabilité (son engagement à amener les élèves vers leurs objectifs) ».

L’acceptation

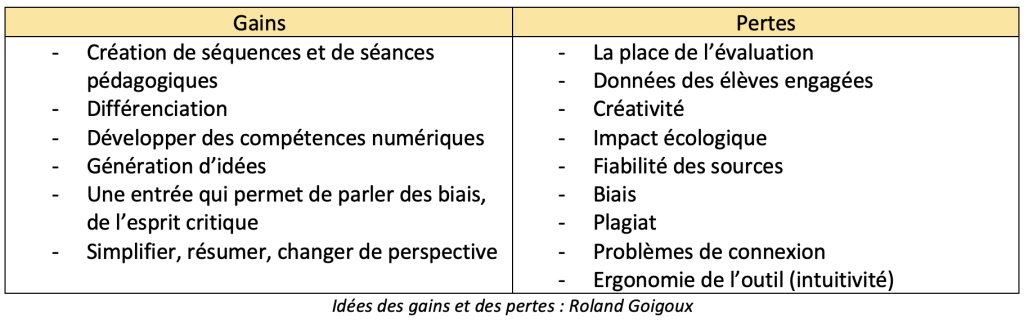

L’acceptation de l’IA ne pourra pas se faire d’elle-même. Un mot-clé est important ici : la formation. Si on ne se forme pas à cet outil, il sera alors impossible de l’accepter. L’acceptation seule est déjà un facteur positif car cela pourra aboutir à une sensibilisation et une formation des élèves. C’est bien cet objectif que nous visons. Pour donner un exemple concret, à la fin d’une formation sur l’intelligence artificielle, une collègue nous dit : « Je vous remercie pour la formation mais sachez que je n’utiliserai pas l’IA. ». De mon côté, je lui ai répondu ceci : « Vous savez, de mon côté j’ai atteint mes objectifs. J’ai devant moi une professionnelle qui a testé l’IA, qui est capable d’expliquer comment cela fonctionne et qui comprend les leviers et les limites de l’outil. De plus, vous avez participé de manière active aux échanges du groupe. ». En effet, cette enseignante a été sensibilisée et peut à son tour répondre aux questions et accompagner ses élèves, le bilan est donc positif. Lorsque l’on teste un outil, on se base sur sa propre expérience. Plus cette expérience en lien avec les outils numériques est courte ou tout simplement fragile, moins on pourra se questionner sur son utilisabilité en classe. S’engage alors un jeu interne de gains et de pertes, en voici quelques exemples :

Ce n’est seulement que par l’utilisation et l’expérimentation de ces outils qu’il sera possible de rendre visible ce qui est intéressant ou non dans l’utilisation de l’intelligence augmentée dans un contexte de classe. Un changement d’attitude peut déjà s’opérer en répondant aux questionnements liés aux pertes.

L’adoption

« C’est en grande partie l’écart qui peut exister entre les valeurs et les attitudes de l’individu quant au rôle de l’école face aux outils numériques, et celles promues à travers les programmes institutionnels et les injonctions ministérielles, qui conditionne la nature de l’adoption »[7]. La question de l’adoption quand on parle de l’IA est intéressante. L’IA n’est pas imposée en soi par des politiques externes ou par des injonctions particulières, cela dit, elle a réussi à trouver sa place dans nos sociétés, dans nos vies. Deux options s’offrent donc à nous : est-ce que l’on interdit son usage ou est-ce que l’on dompte l’IA ? L’adoption, consentie ou imposée, ou la non-adoption, ne sont pas des éléments immuables, le professionnel peut revenir sur un niveau d’acceptation à tout moment. L’adoption peut être consentie si des côtés bénéfiques sont perçus par l’enseignant ou bien contrainte dans le cas où l’utilisation de l’IA serait perçue comme imposée. Dans le second cas, l’usage pourrait être subi sans réelle conviction. Il semble alors essentiel d’aiguiller les professionnels vers des outils responsables (données, impact écologique,…), des usages éthiques et proposer des usages pédagogiques adaptés.

L’appropriation

Il s’agit du dernier temps si l’on regarde le schéma mais il s’agit, et il faut bien le garder en tête, d’un continuum et non d’un processus linéaire qui aurait une fin. L’appropriation est l’aboutissement de l’usage d’un outil, il s’agit du transfert de connaissances et compétences amassées lors des phases d’acceptation et d’adoption vers d’autres domaines de la vie personnelle ou d’autres champs de la vie professionnelle. En bref, les enseignants s’en emparent, essaient d’innover, d’explorer d’autres champs d’utilisation et intègrent l’IA dans d’autres contextes. Les éléments qui mènent à cette appropriation sont de l’ordre du sentiment de contrôle, de maîtrise de l’outil, ou encore de la bonne formation ainsi que des discussions et échanges avec les pairs. La découverte des possibles autour de l’outil peut remettre en question l’acceptation ou l’adoption de celui-ci lorsqu’il est utilisé dans d’autres contextes.

Mots de conclusion

L’appropriation de l’IA ne pourra pas avoir lieu sans une bonne formation à l’outil. Être sensibilisé soi-même ou être formé est déjà un premier pas vers une meilleure acceptation. Il est important de garder en tête que l’on peut ne pas accepter un outil mais l’adopter tout de même. Dans tous les cas, la remise en question des outils en lien avec l’intelligence augmentée est essentielle afin de mieux pouvoir sensibiliser les élèves à ces questions. L’analyse des résistances enseignantes face à l’IA à travers le prisme des 4A met en évidence que ces freins ne relèvent pas uniquement d’une question technologique, mais aussi de facteurs humains, organisationnels et éthiques. Pour conclure, il me semble que l’intelligence artificielle crée un terrain fertile qui permet des échanges entre collègues, qui alimente des discussions riches avec les élèves, qui nous permet également de réfléchir sur nos valeurs et notre éthique personnelle et professionnelle et, par extension, de nous faire réfléchir sur ce qu’est l’acte d’enseigner.

Tableau de synthèse : IA, enseignement et résistances

Notes de bas de page :

[4] Capucine Bauchet, Blandine Hubert, Jérôme Dinet. Entre acceptabilité et appropriation des outils numériques intégrés dans le système éducatif : Le modèle des 4A. 13ème colloque international RIPSYDEVE “ La psychologie du développement et de l’éducation pour le 21ème siècle : nouveaux objets, espaces et temporalités ”, Oct 2020, Nancy, France. pp.158-161. ffhal-03107250f

[5] Référence au triangle pédagogique d’Houssaye (Exemple de lecture sur le sujet : https://blog.inspe-bretagne.fr/arts-plastiques-m1m2/wp-content/uploads/jean-Houssaye-triangle-pedagogique.pdf)

[7] Capucine Bauchet, Blandine Hubert, Jérôme Dinet. Entre acceptabilité et appropriation des outils numériques intégrés dans le système éducatif : Le modèle des 4A. 13ème colloque international RIPSYDEVE “ La psychologie du développement et de l’éducation pour le 21ème siècle : nouveaux objets, espaces et temporalités ”, Oct 2020, Nancy, France. pp.158-161. ffhal-03107250f

[8] Sans données personnelles